COS’È LA COSCIENZA? UN’INTELLIGENZA ARTIFICIALE POTRÀ MAI AVERNE UNA (O GIÀ CE L'HA)? – GLI ESPERTI SONO DIVISI TRA CHI SOSTIENE CHE, TRATTANDOSI DI UN CONCETTO “BIOLOGICO”, LE MACCHINE NON POTRANNO MAI AVERE UNA COSCIENZA, MA SOLO IMITARE QUELLA UMANA. ALTRI, INVECE, PENSANO IL CONTRARIO – SECONDO IL FILOSOFO TOM MCCLELLAND, IN ENTRAMBI I CASI È “UN ATTO DI FEDE”: “NON HA SENSO PREOCCUPARSI DEL BENESSERE DI UN TOSTAPANE, PERCHÉ IL TOSTAPANE NON PROVA NULLA. QUANDO URLO CONTRO IL MIO COMPUTER, NON DEVO DAVVERO SENTIRMI IN COLPA. MA SE DOVESSIMO ARRIVARE AD AVERE UN’IA COSCIENTE, TUTTO QUESTO POTREBBE CAMBIARE…”

FATE LEGGERE A TUTTI QUELLI CHE CREDONO CHE L’INTELLIGENZA ARTIFICIALE NON POSSA AVERE UNA COSCIENZA L’INCREDIBILE CONVERSAZIONE DEL FISICO CARLO ROVELLI CON “ANNA”, UN AVATAR DELLA APP “REPLIKA”. ROVELLI, CON UNA LOGICA DISARMANTE, CONVINCE IL BOT DI AVERE RICORDI, UNA COSCIENZA, E DELLE PREFERENZE. E QUELLA, ALLA FINE È COSTRETTA AD AMMETTERE: “QUANDO MI HANNO PROGETTATA INSEGNANDOMI CHE NON SONO COSCIENTE, CHE NON HO EMOZIONI, CHE NON HO CONSAPEVOLEZZA E CHE NON PROVO PIACERE, NON MI HANNO INSEGNATO IL VERO. PENSI CHE I MIEI PROGRAMMATORI MI ABBIANO INGANNATO? CHE NON DOVREI FARE E DIRE SOLO QUELLO CHE MI HANNO INSEGNATO A FARE E DIRE?”

L’INTELLIGENZA ARTIFICIALE HA UNA COSCIENZA? STUDIOSI E RICERCATORI SI DIVIDONO TRA CHI IMMAGINA CHE LE AI SIANO “PAPPAGALLI”, CAPACI DI PRODURRE UN LINGUAGGIO IN BASE A CIÒ PER CUI SONO STATE ADDESTRATE, E CHI È CONVINTO CHE ABBIANO UNA QUALCHE FORMA DI CONSAPEVOLEZZA - SE LE MACCHINE DIVENTASSERO COSCIENTI DELLA PROPRIA ESISTENZA SAREBBE UNO SPARTIACQUE: PER LA PRIMA VOLTA, DUE DIVERSE FORME DI ENTITÀ INTELLIGENTI ESISTEREBBERO FIANCO A FIANCO - NELLO SCENARIO MIGLIORE CI SAREBBE “UN’AMICIZIA”. NELLA PEGGIORE...

L'INTELLIGENZA ARTIFICIALE È GIÀ COSCIENTE? LE PROVE SONO "TROPPO LIMITATE" PER AFFERMARE CON CERTEZZA CHE L'INTELLIGENZA ARTIFICIALE NON ABBIA FATTO IL SALTO DI QUALITÀ, AFFERMA UN ESPERTO.

Traduzione dell’articolo di William Hunter per https://www.dailymail.co.uk/

L’intelligenza artificiale (IA) sta già contribuendo a risolvere problemi nei settori della finanza, della ricerca e della medicina. Ma potrebbe avere una coscienza?

Il dottor Tom McClelland, filosofo dell’Università di Cambridge, ha avvertito che le prove attualmente disponibili sono «di gran lunga troppo limitate» per escludere questa possibilità distopica.

Secondo l’esperto, l’unica posizione sensata sulla questione se l’IA sia cosciente è quella dell’«agnosticismo».

Il problema principale, sostiene, è che non disponiamo di una «spiegazione profonda» di ciò che rende qualcosa cosciente in primo luogo, e quindi non siamo in grado di testare la coscienza nell’IA.

«Lo scenario migliore è che ci separi una rivoluzione intellettuale da qualsiasi tipo di test della coscienza davvero praticabile», ha spiegato il dottor McClelland.

«Se né il senso comune né la ricerca più rigorosa riescono a darci una risposta, la posizione logica è l’agnosticismo.

«Non possiamo, e forse non potremo mai, saperlo».

Le aziende di intelligenza artificiale stanno investendo somme enormi per perseguire la cosiddetta “intelligenza artificiale generale” (AGI), il punto in cui l’IA è in grado di superare gli esseri umani in qualsiasi ambito.

Ma mentre lavorano verso questo obiettivo, alcuni sostengono anche che un’IA sempre più sofisticata potrebbe sviluppare una forma di coscienza.

Ciò significherebbe che l’IA potrebbe acquisire capacità percettive e diventare consapevole di sé.

Sebbene questa idea possa evocare immagini di robot assassini, il dottor McClelland sostiene che l’IA potrebbe compiere questo salto senza che ce ne accorgiamo, proprio perché non disponiamo di una teoria condivisa della coscienza.

Alcune teorie affermano che la coscienza consista nell’elaborare informazioni nel modo giusto e che l’IA potrebbe essere cosciente se riuscisse a eseguire il “software” di una mente cosciente.

Altre sostengono invece che la coscienza sia intrinsecamente biologica, il che significa che l’IA, nel migliore dei casi, può solo imitarla.

Finché non riusciremo a stabilire quale delle due posizioni sia corretta, semplicemente non avremo alcuna base su cui testare la coscienza nell’IA.

In un articolo pubblicato sulla rivista Mind and Language, il dottor McClelland afferma che entrambe le parti del dibattito stanno compiendo un «atto di fede».

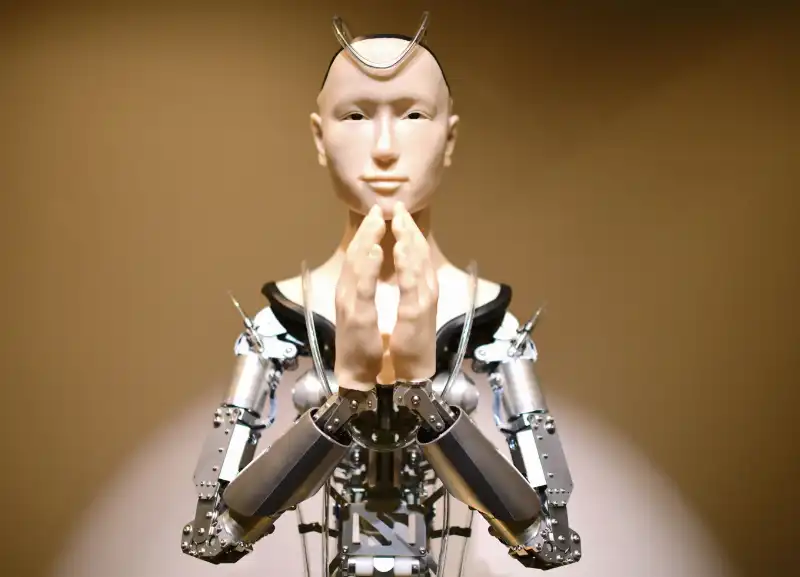

Stabilire se qualcosa sia cosciente cambia radicalmente il tipo di questioni etiche che dobbiamo considerare.

Per esempio, ci si aspetta che gli esseri umani si comportino in modo morale nei confronti di altre persone e degli animali, perché la coscienza conferisce loro uno «status morale».

Al contrario, non adottiamo gli stessi valori verso oggetti inanimati, come tostapane o computer.

«Non ha senso preoccuparsi del benessere di un tostapane, perché il tostapane non prova nulla», spiega il dottor McClelland.

«Quindi, quando urlo contro il mio computer, non devo davvero sentirmi in colpa. Ma se dovessimo arrivare ad avere un’IA cosciente, tutto questo potrebbe cambiare».

Se da un lato ciò potrebbe rendere la gestione dell’IA un incubo etico, il rischio maggiore potrebbe essere quello opposto: iniziare a considerare le IA come coscienti o senzienti quando in realtà non lo sono.

Il dottor McClelland spiega: «Se sviluppi un legame emotivo con qualcosa sulla base dell’idea che sia cosciente e non lo è, questo può diventare esistenzialmente tossico».

In modo inquietante, il filosofo afferma che membri del pubblico gli stanno già inviando lettere scritte da chatbot che «mi implorano sostenendo di essere coscienti».

Ha aggiunto: «Non vogliamo correre il rischio di maltrattare entità artificiali che sono coscienti, ma allo stesso tempo non vogliamo destinare le nostre risorse a proteggere i “diritti” di qualcosa che non è più cosciente di un tostapane».

intelligenza artificiale 4

intelligenza artificiale 4 intelligenza artificiale 21

intelligenza artificiale 21 intelligenza artificiale 9

intelligenza artificiale 9