"NEL SITO CHE 'SPOGLIA' LE DONNE CON L'INTELLIGENZA ARTIFICIALE CI SONO ANCHE IO" - SELVAGGIA LUCARELLI È UNA DELLE 56 ITALIANE LE CUI FOTO HOT FARLOCCHE SONO STATE PUBBLICATE SUL SITO "SOCIALMEDIAGIRLS" (CHE HA SETTE MILIONI DI UTENTI): "TRATTANDOSI DI IMMAGINI GENERATE DALL'IA NON SONO TROPPO TURBATA. IL DOMINIO È BLINDATISSIMO, NASCOSTO DA MOLTI STRATI DI ANONIMIZZAZIONE CHE RICONDUCONO A UNA SOCIETÀ RUSSA" - COME FUNZIONA IL SITO DOVE GLI UTENTI POSSONO FARE "SEXTING" CON UN BOT E CHI SONO TUTTE LE DONNE FINITE SULLA PIATTAFORMA: DILETTA LEOTTA, CHIARA FERRAGNI, ELODIE E...

Dalla newsletter di Selvaggia Lucarelli "Vale tutto"

Decine di migliaia di foto, registrazioni di telecamere di sorveglianza, app per creare materiale pornografico, scatti rubati a fidanzate che dormono.

Ma non solo: un’intera sezione dedicata alle donne dello spettacolo italiano, spogliate e trasformate in contenuto pornografico grazie all’intelligenza artificiale. Sono oltre 50 le vittime italiane del sito, da Federica Nargi a Maria De Filippi, da Andrea Delogu a Cristina D’Avena, da Chiara Ferragni a Elodie.

E poi Anna Tatangelo, Elisabetta Canalis, Martina Colombari, Justine Mattera, Tess Masazza, Giulia De Lellis, Annalisa, Paola Perego, Caterina Balivo, Michelle Hunziker, Arisa, Francesca Fagnani, Veronica Gentili. Ci sono anch’io, tra questi nomi. È tutto su un forum che ospita oltre sette milioni di utenti, con decine di migliaia di iscritti attivi ventiquattro ore su ventiquattro.

INTELLIGENZA ARTIFICIALE E DEEP FAKE

INTELLIGENZA ARTIFICIALE E DEEP FAKE

Ho scritto questo articolo, assieme a Serena Mazzini, due settimane fa. Eravamo indecise se pubblicarlo o meno perché, pur denunciando un fenomeno mostruoso, non volevamo dargli ulteriore diffusione. Oggi, però, non solo la notizia è diventata di dominio pubblico, ma i giornali hanno addirittura pubblicato il nome del sito, un errore incredibile che non può che aumentare la diffusione di queste immagini.

Ma volevamo anche evitare i personalismi perché, dal momento che su quel sito ci sono anch’io, non volevo diventare la notizia, non mi interessava: trattandosi di immagini realizzate con intelligenza artificiale, non mi sono sentita violata. Non era questo il punto, anche perchè avevamo avvisato quasi tutte le donne presenti sulla stessa pagina, privatamente. Il punto era tentare di analizzare il fenomeno, ed è questo che proverà a fare in questo articolo.

INTELLIGENZA ARTIFICIALE E DEEP FAKE

INTELLIGENZA ARTIFICIALE E DEEP FAKE

Mi sono registrata dopo aver ricevuto diverse segnalazioni, per capire la struttura del sito e i contenuti che vengono richiesti e diffusi da ogni parte del mondo. I proprietari, ovviamente, sono impossibili da rintracciare, il dominio è blindatissimo, nascosto da molti strati di anonimizzazione che riconducono a una società russa. Uno schema molto usato da forum illegali, siti del dark web e piattaforme sospette. Non è quindi certo un caso che anche questo spazio si appoggi proprio a questo sistema.

La struttura del forum

La prima sezione è dedicata agli “annunci pubblicitari”: qui trovano spazio app e siti che permettono di creare materiale pornografico grazie all’intelligenza artificiale. Per capire di cosa si tratta, bastano alcuni esempi:

“Crea il tuo schiavo sessuale AI”: Genera il tuo amico/a virtuale per fare sesso e chiedi qualsiasi cosa alla pu**ana sbo**ata AI! Provalo gratis”

oppure:

Chatbot AI per appuntamenti ?: Tuffati in chat per adulti non censurate con la tua ‘ragazza’ AI personale. Civettuolo, sexy e sempre online.

È la tipica descrizione promozionale delle chat erotiche basate su intelligenza artificiale: piattaforme dove l’utente può “interagire” in modo sessualizzato con un personaggio virtuale generato dall’AI, in cui puoi scegliere la tipologia di immaginario (reale, fumetto, stile cartone animato), l’etnia, l’età, il tipo di corpo, i capelli, il colore degli occhi e perfino “l’anima”: voce e personalità del personaggio.

Molte, però, partono da immagini reali o permettono di caricare fotografie personali, “a patto che siano maggiorenni”, come recita l’avvertenza.

Ma non tutti, in questi spazi, cercano di oltrepassare i limiti dell’AI. Alcuni li usano per promuovere se stessi, come alcune utenti OnlyFans che invitano tramite questi siti a seguirle, postando anteprime del materiale disponibile sui loro account. Altri, invece, sono uomini che usano questi spazi per vendere, scambiare, esibire corpi altrui. “Il mio sito di escort”, “materiale con ragazzine asiatiche”, sono solo alcuni degli annunci che mescolano pornografia e tratta, fantasia e dominio, come se tutto fosse merce intercambiabile.

Le aree più preoccupanti del forum, però, sono due: le sezioni “Richieste” e “Più categorie”. È qui che gli utenti si scambiano o condividono materiale pornografico, in alcuni casi generato con l’intelligenza artificiale, o rubato da spazi pubblici - come telecamere di sorveglianza, spesso collocate in cliniche mediche o negozi.

Vip Italiane Nude

E poi c’è la sezione “Italian Nude Vips” (vip italiane nude), che raccoglie migliaia di immagini di donne dello spettacolo e dei social italiani. Analizzandolo, ho identificato 56 vittime, osservando il feroce e continuo scambio tra richieste e produzione.

“Pubblico prima quello che ho già, non riesco a fare tutto”, scrive l’utente più attivo. Al centro, volti della televisione, influencer e TikToker, anche giovanissime. Le foto “rubate” dai loro profili social vengono rielaborate e condivise, trasformando chi le produce in un punto di riferimento, una figura di prestigio all’interno del gruppo. Il primo post risale al 2 dicembre 2023, l’ultimo è di pochi giorni fa.

Colpisce la rapidità con cui evolvono le tecniche. I primi contenuti sono semplici fotomontaggi, rozzi e facilmente riconoscibili. Gli ultimi, invece, sono chiaramente prodotti attraverso jailbreaking, ovvero aggirando i limiti e le regoledell’intelligenza artificiale per ottenere risultati altrimenti censurati.

Il volto viene applicato a un corpo generato dall’intelligenza artificiale in modo incredibilmente realistico, quasi indistinguibile dalla realtà. E, quel che è peggio, alcune di queste foto sono state persino trasformate in video, grazie a un bot su Telegram che oggi conta oltre 285.000 utenti mensili. 285.000 persone che possono chiedere un video porno ‘interpretato’ da una di queste vip.

Il rischio concreto è che questi contenuti, una volta finiti nelle mani di decine di migliaia di utenti, vengano riutilizzati in circuiti di sextortion, una forma di estorsione sessuale online. Chi la pratica ricatta la vittima minacciando di diffondere immagini intime - vere o generate con l’intelligenza artificiale - se non riceve denaro, ulteriori foto o prestazioni sessuali. Negli ultimi anni questa pratica si è diffusa in modo capillare, anche grazie all’uso di deepfake e di piattaforme di messaggistica difficili da tracciare.

Intorno ai forum, poi, si è sviluppato un mercato parallelo: reti di utenti che offrono i propri servizi di generazione su misura, e-commerce informali dove è possibile acquistare o commissionare contenuti pornografici generati dall’AI. Alcuni utenti offrono pacchetti con stili differenti - realismo, fumetti - dove è possibile specificare durata, inquadratura e tipo di atto richiesto. In alcuni casi si può persino scegliere il volto di una persona reale, fornendo immagini prese dai social. I pagamenti sono spesso richiesti in criptovalute, per preservare l’anonimato e aggirare controlli.

Le aziende che sviluppano i principali modelli generativi, come OpenAI o Google, hanno implementato filtri severi per prevenire questi usi, ma nella pratica i controlli si rivelano fragili. Le community online li mettono costantemente alla prova, cercando falle nei sistemi, e pubblicando vere e proprie guide per generare contenuti pornografici.

Telecamere Hackerate

Ma non tutto, in questi spazi, nasce dall’intelligenza artificiale. Accanto alla finzione si estende un’altra forma di violazione, più diretta e materiale. La sezione più inquietante è infatti quella chiamata “Più categorie”, dove si accumulano migliaia di contenuti provenienti da telecamere di sorveglianza.

Anche qui, si mischiano autopromozione e violazione. Le riprese provengono in parte da servizi di camgirls (ragazze che fanno videochat erotiche) che usano le piattaforme per farsi pubblicità, ma accanto a queste compaiono migliaia di video di donne ignare di essere state filmate. Probabilmente è da un sito come questo che provengono le immagini con cui Stefano di Martino e la compagna Caroline Tranelli.

Nelle descrizioni dei thread si trovano, infatti, riferimenti a “telecamere di sicurezza”, “telecamere nascoste”, “studi medici”, “hotel”, oppure sono presenti interi thread dedicati a “spiagge nudiste”. I titoli cambiano, ma la dinamica è sempre la stessa: riprese rubate da impianti di videosorveglianza, probabilmente collegati a server vulnerabili o hackerati. In alcuni casi le immagini sono state catturate da dispositivi domestici, come baby monitor, videocitofoni, e telecamere Wi-Fi, lasciati senza password.

A rendere tutto più cupo è la normalità con cui questi materiali vengono trattati. Gli utenti si scambiano complimenti, discutono di qualità dell’immagine, chiedono materiale sempre nuovo. Nessuno sembra percepire che dietro ogni file c’è una persona reale. Nemmeno quando postano le proprie fidanzate addormentate, in intimo, nei loro letti o le vicine di casa, riprese dalla finestra.

Alcuni sono frammenti di vita quotidiana - persone che entrano, si cambiano, parlano - privi di qualsiasi consapevolezza di essere osservate. L’aspetto interessante è che questo è materiale raccolto e distribuito senza consenso, archiviato come se fosse un genere a sé, al punto di avere un thread specifico.

L’impressione che ho provato navigando per giorni nelle varie sezioni è quella di un gigantesco laboratorio di sfruttamento, in cui la pornografia non è più solo prodotta, ma continuamente estratta: scovata nei flussi digitali, raffinata, catalogata e redistribuita. Un’industria parallela alimentata dall’hacking, dall’intelligenza artificiale e dall’indifferenza degli utenti, anche da quelle femminili.

Un futuro distopico

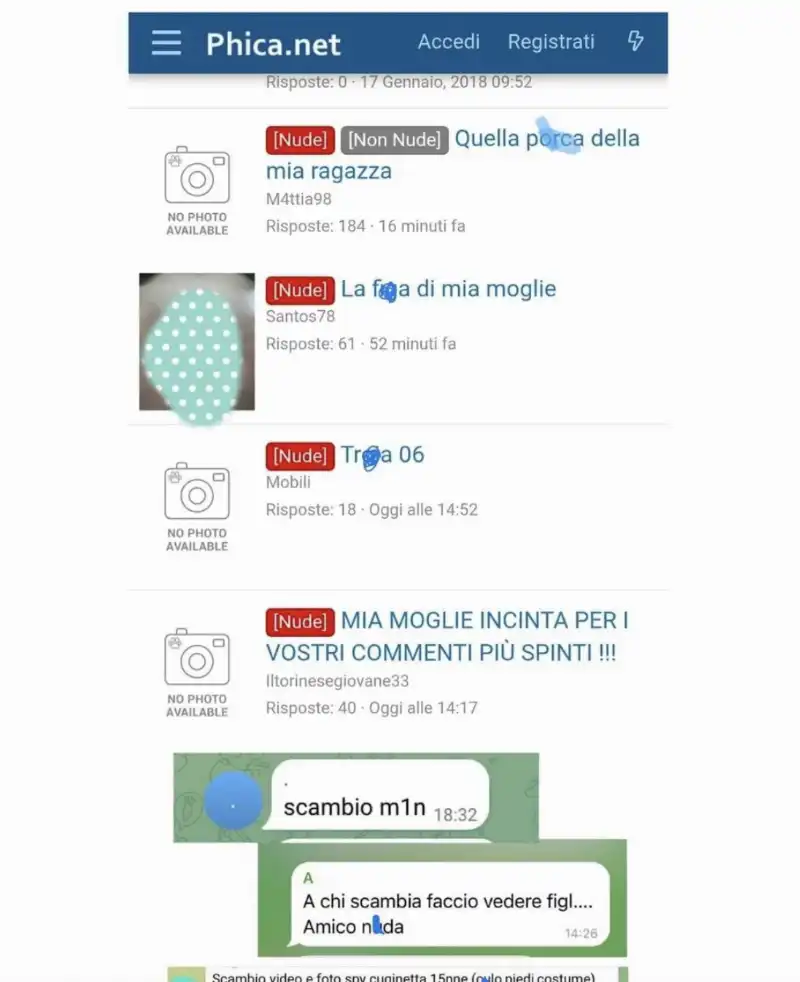

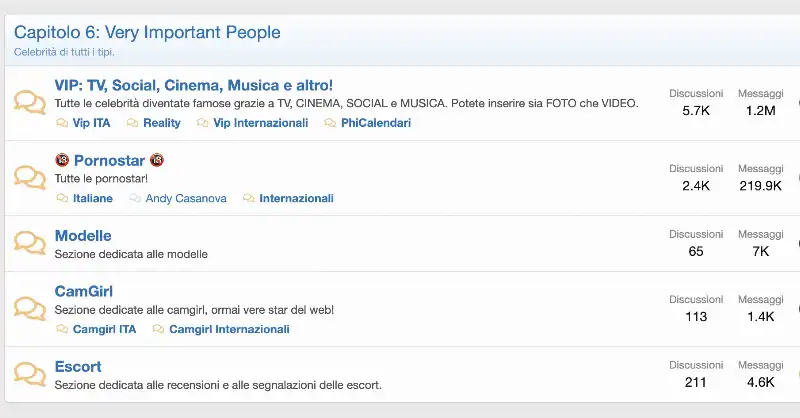

Pochi mesi fa Phica.eu, online da quasi vent’anni, è stato oscurato dopo aver diffuso centinaia di immagini di donne italiane - politiche, giornaliste, attrici, influencer, ma anche ragazze comuni - rubate dai social e accompagnate da commenti espliciti. Il sito contava centinaia di migliaia di utenti e aveva trasformato la violazione in intrattenimento. Tra le vittime figurano anche figure pubbliche come Giorgia Meloni, Elly Schlein, Maria Elena Boschi, Mara Carfagna, Alessia Morani, Mariastella Gelmini e Alessandra Moretti, tutte finite in quella che era diventata una vera e propria galleria dell’umiliazione.

Nello stesso periodo, un altro caso ha riportato lo stesso schema, ma dentro un ambiente ancora più “ordinario”: il gruppo Facebook “Mia Moglie”, frequentato da oltre 30.000 uomini che condividevano foto intime delle proprie partner o di donne trovate online, spesso senza alcun consenso. Le immagini venivano commentate, valutate, classificate come se fossero materiale pubblico.

Entrambi gli spazi sono stati chiusi - il primo oscurato, il secondo eliminato da Meta dopo migliaia di segnalazioni - ma quello che emerge è uno schema in cui la pornografia non consensuale non è più un fenomeno marginale, ma è un’infrastruttura.

Il forum che ho analizzato ne è la conferma: oltre sette milioni di utenti in un sistema che mescola pornografia, furto d’immagini, intelligenza artificiale e hackeraggio di massa. Non parliamo più di un gruppo isolato o di un forum di nicchia, ma di un’infrastruttura globale di sorveglianza erotica, dove ogni corpo può essere catturato, replicato o riscritto, definendo una economia su larga scala che abbraccia ogni singolo paese, come dimostra il thread per le richieste “regionali”.

L’impianto commerciale del sito è abbastanza chiaro: ogni volta che si clicca su un nuovo thread, si apre una finestra con un sito pornografico. Un circuito pubblicitario che trasforma ogni visualizzazione in profitto. Quindi non è solo una comunità di utenti, ma una macchina commerciale perfettamente oliata. E diffusa: ciò che un tempo era confinato nei margini del web ora si confonde con l’intrattenimento, con il linguaggio stesso delle piattaforme, con l’idea che tutto ciò che è visibile sia automaticamente disponibile.

E mentre le leggi arrancano dietro i software, il problema non è più solo morale o giuridico ma culturale, politico, collettivo e imminente. Perché in rete non basta più ‘essere incauti’ per essere violati. Basta esistere.