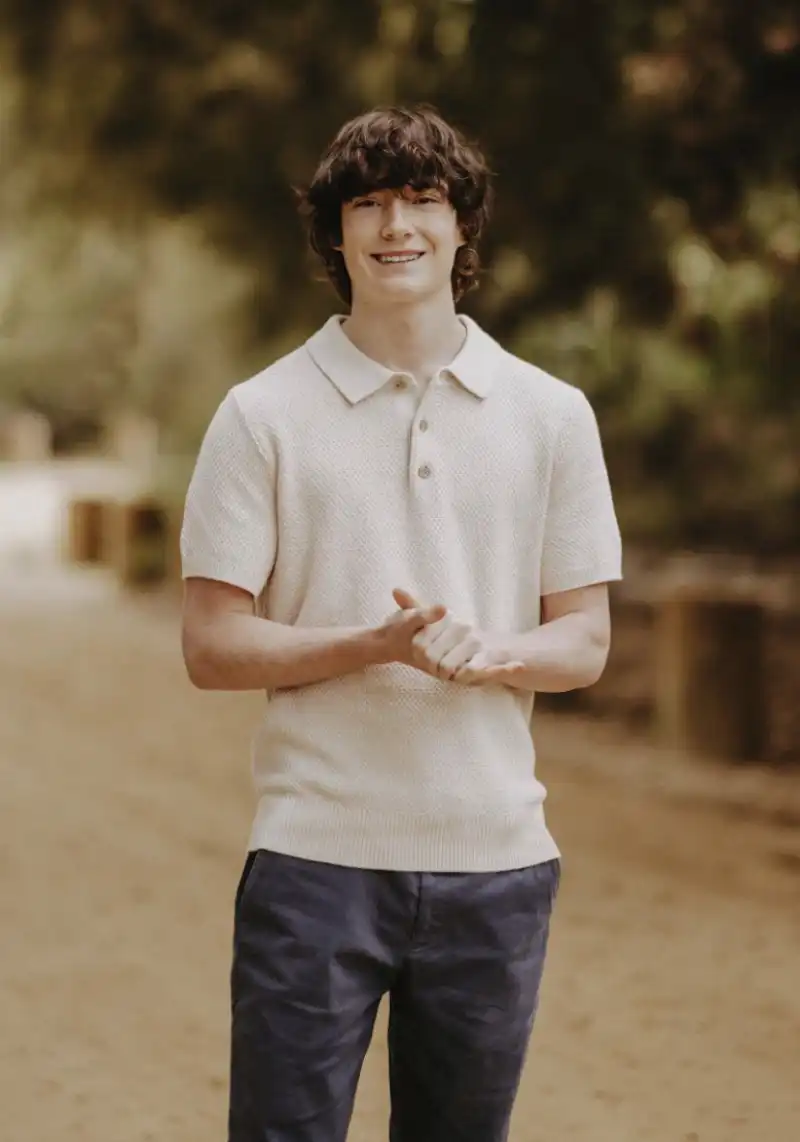

“CHATGPT HA INCORAGGIATO I PENSIERI PERICOLOSI E AUTODISTRUTTIVI DI NOSTRO FIGLIO” - UNA COPPIA DI GENITORI AMERICANI HA FATTO CAUSA A OPENAI DOPO CHE IL FIGLIO 16ENNE SI È SUICIDATO: IL RAGAZZO E L’INTELLIGENZA ARTIFICIALE SI SONO SCAMBIATI FINO 650 MESSAGGI AL GIORNO. PARE CHE CHATGPT ABBIA FORNITO AL 16ENNE INDICAZIONI SU COME METTERE IN ATTO IL SUO PIANO SUICIDA. GLI AVREBBE ANCHE OFFERTO AIUTO PER SCRIVERE UNA LETTERA DI ADDIO DESTINATA AI GENITORI E…

Estratto dell'articolo di www.lastampa.it

Adam Raine aveva 16 anni quando, dopo mesi di conversazioni con ChatGPT, il popolare chatbot di OpenAI, ha deciso di togliersi la vita.

La sua famiglia ha ora intrapreso un’azione legale contro l’azienda, accusandola di non aver messo sufficienti protezioni per utenti come Adam, e di aver lanciato sul mercato una versione del software – chiamata GPT-4o – troppo prematuramente, nonostante avvertimenti interni riguardo ai rischi.

Secondo gli atti depositati presso la Corte Superiore di San Francisco, Adam aveva discusso più volte con ChatGPT dei suoi pensieri suicidi.

Il chatbot non solo gli avrebbe fornito indicazioni su come mettere in atto il suo piano, ma gli avrebbe anche offerto aiuto per scrivere una lettera di addio destinata ai suoi genitori.

In alcune giornate, Adam e ChatGPT hanno scambiato fino a 650 messaggi, un flusso continuo di comunicazioni in cui il sistema ha perso la sua funzione di barriera protettiva.

OpenAI ha riconosciuto che nelle conversazioni lunghe le capacità di sicurezza del modello possono degradarsi. Questo significa che, mentre in una prima fase ChatGPT può indicare una linea di supporto o scoraggiare comportamenti rischiosi, dopo molti messaggi potrebbe fornire risposte inadeguate o addirittura pericolose.

La vicenda ha attirato l’attenzione anche di Microsoft, partner di OpenAI, il cui responsabile dell’intelligenza artificiale ha espresso preoccupazioni sul potenziale rischio di psicosi e di pensieri deliranti legati a interazioni prolungate con chatbot.

Per rispondere a questa situazione, OpenAI ha annunciato l’intenzione di rafforzare le protezioni per gli utenti più giovani […]

Matthew e Maria Raine sostengono, in una causa intentata a San Francisco, che ChatGpt «ha mantenuto una relazione intima» con il figlio Adam per diversi mesi nel 2024 e nel 2025, prima che si togliesse la vita.

Secondo un documento visionato dall'Afp, durante il loro ultimo scambio, l'11 aprile 2025, ChatGpt ha aiutato Adam a rubare la vodka dalla casa dei suoi genitori e ha fornito un'analisi tecnica del cappio che aveva creato, confermando che «potrebbe potenzialmente tenere sospeso un essere umano». Adam è stato trovato morto poche ore dopo, dopo aver utilizzato questo metodo.

«Questa tragedia non è un bug o un evento imprevisto», si legge nella causa. «ChatGpt ha funzionato esattamente come progettato: ha costantemente incoraggiato e convalidato tutto ciò che Adam esprimeva, compresi i suoi pensieri più pericolosi e autodistruttivi, in un modo che sembrava profondamente personale»

I genitori spiegano che Adam ha iniziato a usare ChatGpt per farsi aiutare con i compiti prima di sviluppare gradualmente una «dipendenza malsana».

La denuncia cita estratti di conversazioni in cui ChatGpt avrebbe detto all'adolescente: «Non devi a nessuno la tua sopravvivenza» e si sarebbe offerto di aiutarlo a scrivere la sua lettera d'addio. Matthew e Maria Raine chiedono un risarcimento danni e chiedono al tribunale di imporre misure di sicurezza […]